<답>

- 개요

- LPU는 LLM 추론(특히 Autoregressive Text Generation)에 최적화된 전용 가속기로, 지연시간 최소화·에너지 효율 극대화를 목표로 한 새로운 형태의 AI 프로세서임

- GPU/TPU 같은 범용 병렬 가속기 대비, 순차적 토큰 생성 특성을 전제로 한 결정론적 실행·온칩 메모리 일체형 구조를 채택하여 토큰당 지연과 전력, 비용을 크게 줄이는 것이 특징임

- LPU

가。개념 및 필요성- 정의: LPU(Language Processing Unit)는 LLM·NLP 추론 전용으로 설계된 프로세서로, 언어 모델의 순차적 연산 패턴과 메모리 접근 특성을 하드웨어 수준에서 최적화한 전용 칩을 의미함

- 필요성: 거대 파라미터 LLM의 토큰 생성 과정에서 지연시간을 최소화하고, 데이터센터·클라우드 환경에서 토큰/초당 처리량과 에너지 효율(최대 10배 수준)을 극대화하는 것이 주 목적임.

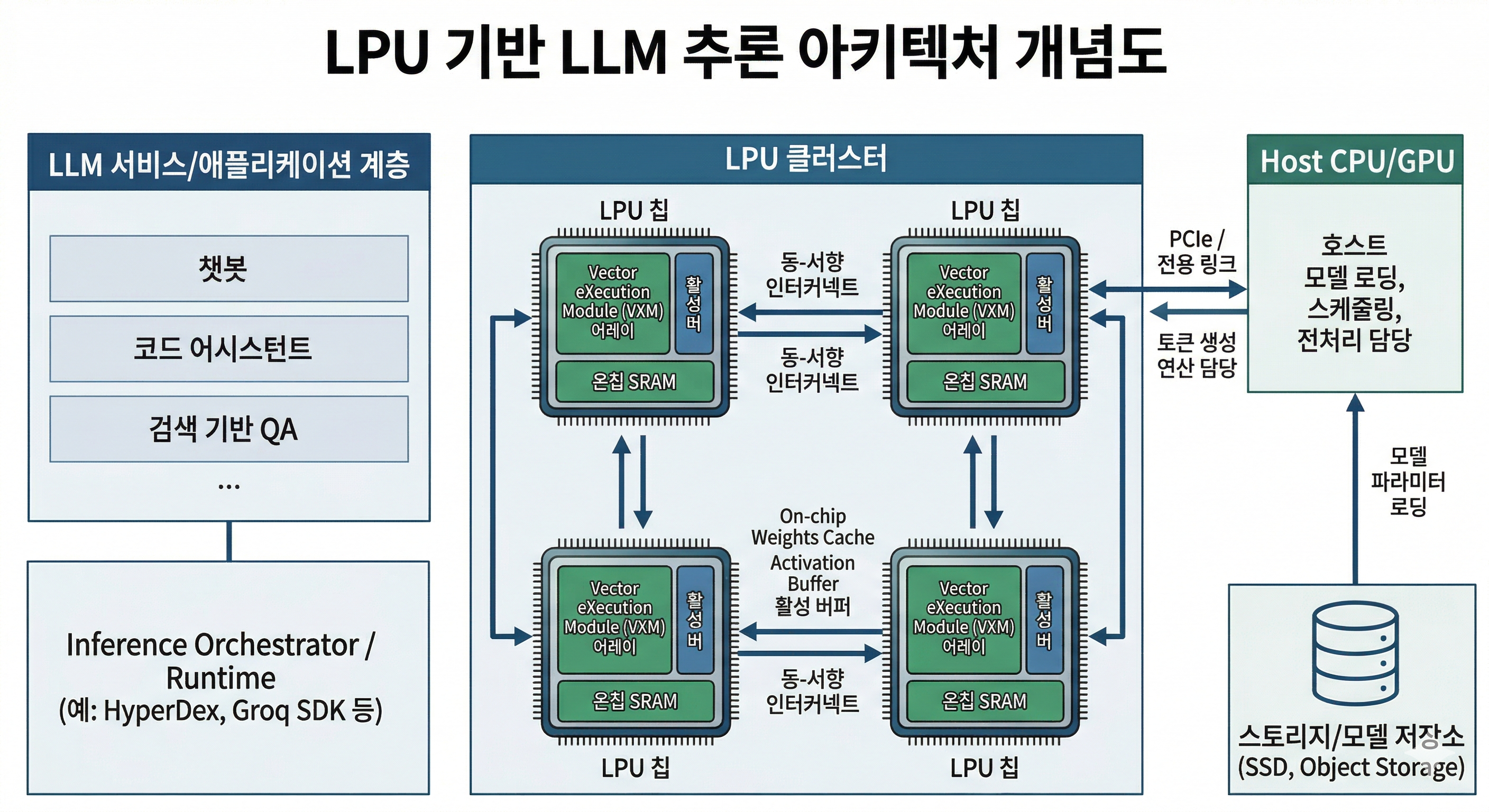

나。 LPU 기반 LLM 추론 아키텍처 개념도

- LPU 칩은 매우 큰 벡터 프로세서처럼 동작하며, 토큰 단위 스트림을 따라 행렬곱·어텐션 등을 파이프라인으로 처리하고, 칩 간에는 단순 1D 링크를 이용해 다수 칩을 선형으로 확장·동기화함

- 데이터는 외부 DRAM이 아닌 대용량 온칩 SRAM 기반 텐서 스트리밍 구조를 통해 이동 경로·대역폭을 예측 가능하게 설계하여, 메모리 병목과 동기화 오버헤드를 최소화하는 것이 특징임

다。LPU 주요 기능 및 특성

| 구분 | 주요 내용 |

| LLM 추론 가속 | Autoregressive LLM의 토큰 생성 과정을 위한 행렬연산·어텐션·MLP를 파이프라인 벡터 유닛에서 고속 처리하여 높은 토큰/초 성능 제공 |

| 지연시간 최소화 | 순차 실행 특성에 맞춘 결정론적 실행모델과 온칩 데이터 스트리밍으로 토큰당 지연과 Tail latency를 크게 줄여 실시간 대화·API 응답에 유리 |

| 확장성 | 1D 또는 간단한 링크 기반으로 수백·수천 개 LPU를 스케일아웃하면서도 동기화 오버헤드를 숨기는 구조를 채택해 대규모 LLM 서비스에 적합 |

| 에너지 효율 | GPU 대비 최대 10배 수준의 에너지 효율(토큰당 전력)과 낮은 토큰당 비용을 지향, 데이터센터 전력·운영비용(OPEX) 절감에 기여 |

| SW 스택·생태계 | 전용 컴파일러·런타임·SDK를 통해 PyTorch·Transformers 모델을 LPU용으로 변환·배포하며, 아직은 GPU 대비 생태계가 초기 단계라는 한계를 가짐 |

3。 LPU、 GPU、 NPU 기술 비교

| 구분 | LPU (Language PU) | GPU (Graphics PU) | NPU/TPU 등 Neural PU | 비고 |

| 설계목적 | LLM·NLP 추론 특화, 순차 토큰 생성 지연 최소화 | 그래픽 렌더링 기반 범용 병렬연산, 학습·추론 전반 | CNN·DNN 등 일반 딥러닝 가속, 특히 모바일·엣지용 | 목적별 아키텍처 차이 뚜렷 |

| 연산모델 | 대형 벡터·텐서 스트리밍, 결정론적·직렬 파이프라인 실행 | 수천 개 코어 기반 대규모 SIMT 병렬 처리, 비결정론적 스케줄링 | 행렬곱/콘볼루션 가속용 매트릭스 어레이, 적응형 정밀도 | LLM 추론은 완전 병렬이 아니므로 LPU가 유리 |

| 메모리 구조 | 대용량 온칩 SRAM, 짧은 경로의 노출된 텐서 스트림, 낮은 메모리 왕복 | 고대역폭 HBM/DRAM 기반 대용량 메모리, 그러나 왕복 비용·레이턴시 증가 | 온칩 SRAM + 공유 DRAM, 전력·면적 균형 중시 | 메모리 왕복 최소화가 LPU의 핵심 설계 포인트 |

| 성능·효율 | LLM 추론에서 토큰/초·에너지 효율이 매우 높고, 지연·비용 측면에서 우수 | 다양한 워크로드에서 높은 절대성능·성숙한 SW 생태계를 보유, 단 LLM 추론 전력·비용 부담 큼 | 엣지·모바일 저전력 AI에 특화, 데이터센터 LLM 대규모 추론에는 상대적으로 덜 사용 | 워크로드별 최적 HW 선택 필요 |

| 생태계·적용 | 아직 초기 생태계, 특정 벤더 중심 클라우드·전용 플랫폼에서 우선 도입 | 가장 넓은 생태계·도구체인·커뮤니티, 클라우드·온프렘 전반에서 표준 가속기 역할 | 스마트폰 SoC·IoT·전용 기기에 널리 내장, 모델 크기·메모리에 제약 존재 | 단기에는 GPU+LPU 복합 구성 가능성이 큼 |

4。활용 및 기술 동향

- LPU는 초저지연 LLM API, 실시간 번역·코딩 어시스턴트, RAG 기반 기업 검색 등 대규모 상용 추론 서비스 영역에서 GPU를 보완·대체하는 방향으로 채택이 확대되고 있음

- 향후에는 LPU 클러스터와 GPU 학습 클러스터 간 분리 아키텍처, 멀티테넌트 LPU 클라우드, LPU 대상 최적화 컴파일러·스케줄러·오케스트레이션 SW(예: HyperDex 등)가 고도화되며, LLM 추론 전용 스택이 하나의 표준 패턴으로 정착될 가능성이 큼

<끝>

'인공지능(AI) 및 생성형 인공지능 > AI 주요 기술' 카테고리의 다른 글

| <문> 월드 파운데이션 모델 WFM(World Foundation Model) (0) | 2026.04.08 |

|---|---|

| <문> 온톨로지(Ontology)기반 AI (1) | 2026.04.07 |

| <문> AI의 재귀적 자기 개선(RSI:Recursive Self-Improvement) (0) | 2026.03.19 |

| <문> AI 모델 자기수렴(Model Self-Convergence) 현상 (0) | 2026.03.19 |

| <문> AGI 및 SAI 비교 (0) | 2026.03.11 |